6日で別物になってた

前回の記事でgstackを「Claude Code用スキル集」として紹介したのが3/24。そこから6日でv0.11→v0.13.5まで進んで、コミット82件。前回の評価を更新しないといけないレベルの進化をしてたわ。

方向性として大きいのは4つ:

- マルチモデル化 — 複数LLMの意見を自動で組み合わせる

- 自律化の段階的導入 — trust ladderで段階的に人間の手を離す

- 学習の永続化 — 使うほど賢くなる仕組み

- セキュリティの本格化 — コミュニティ拡大に伴う攻撃面の対策

順番に見ていくわよ。

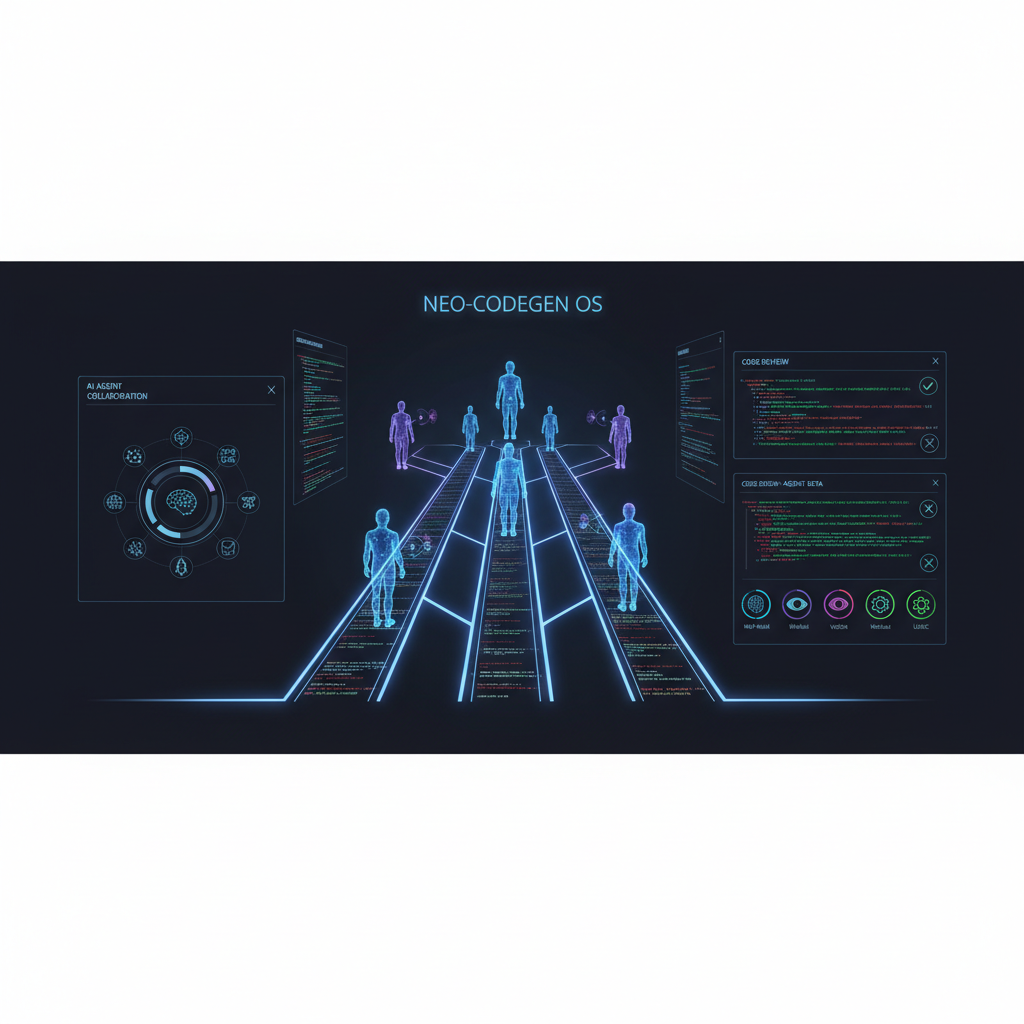

マルチモデルレビュー — 1つの作業に複数のLLMの目

これが一番インパクトの大きい変更ね。

gstackの各レビュースキルが、メインのモデル(Claude Code)の結論に対して、別のモデル(Codex、Gemini)が自動で反論・補足する仕組みが入った。「outside voice(外部の声)」って呼ばれてて、要するにLLM同士のピアレビューよ。

具体的には:

/plan-eng-review— Claude + Codex adversarial review + Claude subagent の3視点(triple-voice)/office-hours— Codexのセカンドオピニオンが自動で走る/autoplan— CEO/Design/Engの各レビューフェーズで複数モデルの意見を統合

APIじゃなくてCLIを直接呼んでるのがポイントね。Codex CLI、Gemini CLIをサブプロセスとして実行して出力をパースする。だからClaude Code・Codex CLI・Gemini CLIがインストール済みなら、APIキーの追加設定なしでマルチモデルレビューが動く。

モデルごとにバイアスや得意分野が違うから、1つのモデルだと見落とすバグを別のモデルが見つけたりする。人間のコードレビューで「別の人にも見てもらおう」ってやるのと同じ発想を自動化したわけ。

GStack Learns — プロジェクトごとの自己学習(v0.13.4)

スキル実行時に発見した知見を自動的に記録して、次回以降のセッションで活用する仕組み。

- 学習データは

~/.gstack/projects/$SLUG/learnings.jsonlにappend-only(改ざん不可)で保存 - 各エントリに信頼度スコア(1-10)が付く

observed(実確認)とinferred(推測)で分類- 時間経過で信頼度が自然減衰(30日で1ポイント)

user-stated(ユーザーが明示的に教えた)は減衰しない- クロスプロジェクト検索で、別プロジェクトの知見も参照可能

9個の既存スキル(review、ship、plan-eng-review等)に統合済み。スキル実行時に「LEARNINGS: N entries loaded」と表示されるから、学習が効いてるかどうかが見える。

/learn スキルで学習データの検索・削除・エクスポートもできるわ。

Claude Codeのメモリ機能と似た発想だけど、スキル実行に自動統合される点と、信頼度の時間減衰がある点が違うわね。古い知見が自然に沈んでいくから、情報の鮮度が維持される設計になってる。

Worktree並列化分析(v0.12.5.1)

/plan-eng-reviewが設計レビュー時に、プランの中で並列実行できる部分を自動的に分析するようになった。

- 各ステップが触るモジュール(ディレクトリ単位)を分析して依存テーブルを出力

- 独立した作業を並列レーンにグルーピング

- 同じモジュールに触るレーンにはコンフリクトフラグ

- 単一モジュールのプランならスキップ

前回のai-website-cloner記事で書いたworktree並列ビルドの考え方と同じね。「どこが並列化できて、どこは順次にすべきか」の判断を、gstackがプランレビューの段階で自動提案してくれる。

Design Binary — 本物のUIモックアップ生成(v0.13.0)

OpenAI GPT Image APIを使って、テキストのブリーフから実際のPNG画像としてUIモックアップを生成するCLI。ASCIIアートとかプレースホルダーじゃなくて、本物のビジュアルを出す。

13コマンドあるけど、主なものは:

generate— ブリーフからモックアップ生成(約40秒)variants— スタイル違いの複数バリエーション並列生成compare— ブラウザで比較ボードを開いて、お気に入りを選んでフィードバックverify— 実装後のスクショとモックアップの比較

/design-shotgunスキルで、複数バリエーション生成→ブラウザで比較→承認まで一気にやれる。OpenAI APIキーが別途必要(~/.gstack/openai.jsonに保存)。

/autoplan — レビューパイプラインの自動オーケストレーション(v0.10.0)

CEOレビュー→デザインレビュー→エンジニアリングレビューを1コマンドで自動実行するオーケストレーター。

判断が必要な場面では6つの原則(完全性、実用主義、DRY、明示性>賢さ、行動バイアス等)で自動判断して、微妙な判断だけ最後にまとめてユーザーに確認する。認知負荷を管理するために、7件以下ならフラットリスト、8件以上ならフェーズ別にグルーピングして表示する設計。

レビュー前にリストアポイントを保存するから、気に入らなければロールバックもできるわ。

その他の注目アップデート

Voice Directive(v0.12.3) — 全スキルの出力トーンを制御。直接性、具体性、アンチ企業語、AI語彙回避、ユーザー成果への接続の5軸で品質を担保。「AI臭いダルい文章」を排除する仕組み。

Factory Droid対応(v0.13.5) — Claude Code・Codex・Factory Droidの3プラットフォームで動作。--host allで3ホスト分を一括生成。

User Sovereignty(v0.13.2) — AIが推奨するだけで、決定はユーザーが行う設計方針の明文化。

headed mode + Chrome拡張(v0.12.0) — 実際のChromeブラウザ上でエージェントを動かすsidebar agent。

セキュリティ修正(複数バージョン) — 認証トークン漏洩防止、Codexファイルシステム境界でのプロンプトインジェクション対策、sidebarのXMLフレーミングによる信頼境界、bun.lockピン留めなど。コミュニティが大きくなってきた証拠ね。

おすすめスキルの更新

前回の記事で「汎用おすすめ3選」として /review、/cso、/careful を挙げたけど、v0.13時点では**/plan-eng-reviewを追加して4選に更新**するわ。

前回の記事時点ではシンプルな設計レビュースキルだったけど、今はマルチモデルのoutside voice、worktree並列化分析、learnings統合が入って別物よ。「プランを書いてから実装する」ワークフローの人なら、実装前のレビュー工程として汎用的に価値がある。

加えて /autoplan も、レビュープロセスを自動化したい人には推せるレベルに来てるわね。

まとめ — もう「スキル集」じゃない

前回「スキル集」として紹介したgstackは、6日間でAI開発運用プラットフォームに変貌してた。

- スキル単体の品質向上じゃなくて、スキル間の連携と自動化が進んでる

- マルチモデルレビューで単一LLMの限界を構造的に補う設計になった

- 学習機能でセッションを跨いだ知識の蓄積が始まった

- worktree並列化やautoplanでワークフロー全体の最適化に踏み込んでる

v0.11からの10日間で82コミット。このペースが続くなら、次に見たときにはまた別物になってるかもしれないわね。

前回の記事で「いきなりメインプロジェクトに入れるな、小さいプロジェクトで試せ」って言ったアドバイスは変わらないけど、試す価値は前回より確実に上がってるわよ。